Pourquoi les tests automatisés sont un investissement, pas une perte de temps

L’argument le plus fréquent contre les tests automatisés dans les équipes de développement : « On n’a pas le temps. » C’est précisément l’inverse de la réalité. Une étude IBM Systems Sciences Institute établit que le coût de correction d’un bug augmente de façon exponentielle selon l’étape à laquelle il est découvert : 1x en développement, 10x en intégration, 100x en production. Chaque bug détecté par un test automatisé avant le déploiement est une économie considérable.

Au-delà du coût de correction, les tests automatisés offrent un filet de sécurité indispensable pour refactoriser du code en confiance, onboarder de nouveaux développeurs sans peur de casser l’existant, et déployer fréquemment en production sans régression.

La pyramide de tests : l’architecture stratégique

La pyramide de tests, popularisée par Mike Cohn, décrit l’équilibre optimal entre les différents types de tests :

- Base — Tests unitaires : nombreux, rapides (millisecondes), isolés. Testent une fonction ou un composant de façon indépendante. La majorité de votre couverture de tests doit venir de là.

- Milieu — Tests d’intégration : testent les interactions entre plusieurs modules, services ou couches applicatives. Plus lents que les tests unitaires mais plus représentatifs.

- Sommet — Tests end-to-end (E2E) : simulent le comportement d’un utilisateur réel dans le navigateur. Très lents, fragiles, coûteux à maintenir. À réserver aux parcours critiques.

L’anti-pattern courant est d’avoir un triangle inversé (peu de tests unitaires, beaucoup de tests E2E) — une suite de tests lente, coûteuse et fragile.

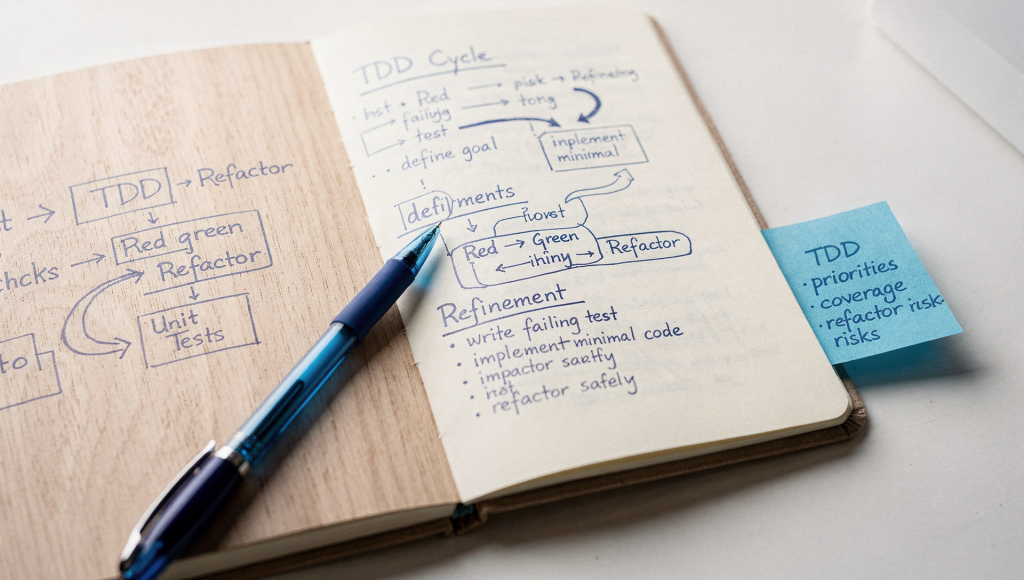

Test Driven Development (TDD) : écrire les tests avant le code

Le TDD inverse l’ordre traditionnel de développement. La boucle TDD (Red-Green-Refactor) :

- Red : écrire un test qui décrit le comportement attendu. Le test échoue (le code n’existe pas encore)

- Green : écrire le minimum de code pour faire passer le test

- Refactor : améliorer le code sans changer son comportement (le test reste vert)

Avantages du TDD : les tests couvrent 100 % du code produit, la conception est guidée par l’usage (code plus modulaire et testable), et la documentation vivante est toujours à jour. Inconvénient : la courbe d’apprentissage est réelle et la productivité baisse temporairement lors de l’adoption.

Outils de tests par catégorie

Tests unitaires JavaScript/TypeScript

- Vitest : en 2026 le standard pour les projets Vite/React/Vue. Ultra-rapide, compatible Jest

- Jest : historiquement le plus utilisé, riche écosystème, support TypeScript natif

- Testing Library : pour les tests de composants React/Vue axés sur le comportement utilisateur plutôt que l’implémentation

Tests end-to-end

- Playwright (Microsoft) : la référence actuelle. Multi-navigateurs (Chromium, Firefox, WebKit), très stable, API élégante, support trace viewer pour le debugging

- Cypress : précurseur, excellent DX, mais limité à Chromium dans sa version de base

Tests d’API

- Supertest (Node.js) : pour tester les API REST en isolation

- Hoppscotch / Bruno : clients REST avec support de collections de tests automatisés

Écrire de bons tests : les bonnes pratiques

Le pattern AAA (Arrange-Act-Assert)

Structurez chaque test en trois phases : Arrange (préparer les données et le contexte), Act (exécuter l’action testée), Assert (vérifier le résultat attendu). Cette structure rend les tests lisibles et maintenables.

Tests comportementaux, pas d’implémentation

Testez ce que le code fait (comportement observable), pas comment il le fait (implémentation interne). Un test qui casse à chaque refactoring alors que le comportement n’a pas changé est un mauvais test. Utilisez React Testing Library plutôt qu’Enzyme : « Test behavior, not implementation. »

Mocks et stubs : quand et comment

Les mocks isolent le code testé de ses dépendances externes (APIs, base de données, horloge système). À utiliser avec parcimonie : trop de mocks produisent des tests qui passent même quand le système réel est cassé. Les tests d’intégration avec de vraies dépendances (base de données de test, API de sandbox) sont souvent plus fiables.

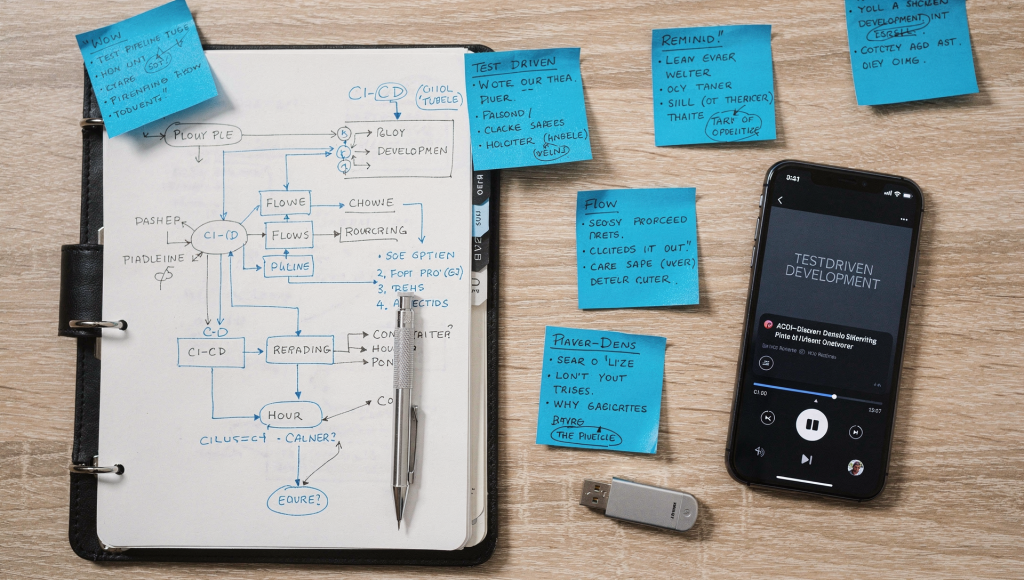

Intégrer les tests dans la CI/CD

Les tests n’ont de valeur que s’ils sont exécutés automatiquement à chaque modification de code. Une pipeline CI/CD typique :

- Push sur la branche → déclenchement de la pipeline (GitHub Actions, GitLab CI, Jenkins)

- Installation des dépendances

- Lint et vérification des types TypeScript

- Tests unitaires et d’intégration (rapides, toujours)

- Build de l’application

- Tests E2E (sur environnement de staging, éventuellement en parallèle)

- Déploiement conditionnel à tous les tests verts

Métriques de couverture de code

Le taux de couverture de code (coverage) mesure le pourcentage de lignes, branches et fonctions couvertes par les tests. C’est un indicateur utile mais à relativiser : 80 % de couverture sur un module critique vaut mieux que 95 % de couverture avec des tests superficiels. Ne courez pas après un chiffre de coverage — courez après la pertinence de ce qui est testé.

Erreurs fréquentes à éviter

- Ajouter les tests après coup : tester un code qui n’a pas été conçu pour être testable est douloureux. Intégrez les tests dès le début

- Des tests trop couplés à l’implémentation : si chaque refactoring casse 50 tests, l’équipe finit par désactiver les tests plutôt que de les corriger

- Négliger la maintenabilité des tests : du code de test dupliqué et mal organisé devient un fardeau

- Viser 100 % de couverture à tout prix : tester du code trivial (getters simples) est du temps perdu

- Tests E2E trop fragiles : des selecteurs basés sur des attributs CSS instables créent des tests qui flakent aléatoirement

Conclusion

Une stratégie de tests bien conçue est un multiplicateur de vélocité, pas un frein. Les équipes qui testent bien déploient plus souvent, avec plus de confiance, et passent moins de temps à débugger en production. Commencez par les tests unitaires sur les fonctions critiques, intégrez Vitest ou Jest dans votre projet, et montez en puissance progressivement vers les tests d’intégration et E2E.

Questions fréquentes sur

Tests automatisés en développement web

Un taux de 70 à 80 % de couverture sur les modules critiques est un objectif raisonnable. En dessous de 50 %, les risques de régression sont élevés. Au-dessus de 90 %, on commence souvent à tester des cas triviaux. La qualité prime sur la quantité.

Le TDD est particulièrement adapté aux fonctions à logique complexe, aux algorithmes métier et aux APIs. Il est moins naturel pour les interfaces graphiques et le CSS. Une approche hybride (TDD sur la logique, tests comportementaux sur l'UI) est souvent pragmatique.

Montrez la valeur par l'exemple : commencez par un module, mesurez le temps économisé en debugging, partagez les résultats. Les arguments théoriques convainquent rarement autant qu'un exemple concret où les tests ont évité un bug en production.